谷歌正式发布Gemma 4—— 迄今为止最智能的开源大模型。它以 “本地运行 + 原生多模态” 为核心卖点,一经上线便登顶各大 AI 排行榜,被广泛认为是当前最值得部署的本地大模型。

一、四大版本覆盖全场景

谷歌推出了 4 个不同规模的版本,完美适配从手机到高端 GPU 的所有硬件:

| 模型系列 | 参数规模 | 类型 | 适用设备 | 核心特点 |

|---|---|---|---|---|

| 轻量级 | 2B | 稠密模型 | 手机 / IoT 设备 | 极低延迟,主打多模态 |

| 轻量级 | 4B | 稠密模型 | 入门级显卡 | 平衡速度与精度,Ollama 最热门版本 |

| 高性能 | 26B | 专家混合模型 (MoE) | 中端显卡 | 复杂推理,编程能力突出 |

| 旗舰级 | 31B | 稠密模型 | 高端显卡 | 接近云端模型效果,支持 Agent |

二、碾压级性能表现

Gemma 4 最大的突破在于 **”单位参数智能水平”**,在 Arena-Hard 排行榜中:

- 31B 版本排名第 3,超过了部分 20 倍参数量的闭源模型

- 26B 版本排名第 6,成为性价比最高的开源模型

这标志着开源 AI 正式进入 “效率优先” 时代,小模型也能完成过去只有大模型才能胜任的任务。

三、核心能力一览

Gemma 4 不再是单一的文本模型,而是一个完整的 AI 系统:

- ✅ 原生多模态:图像识别 (OCR)、视频理解、音频输入 (小模型支持)

- ✅ 超强编程:离线代码生成、Web 开发、自动生成 Docker 配置

- ✅ Agent 能力:自动任务执行、工具调用、工作流自动化

- ✅ 多语言支持:覆盖 140 + 语言,中文表现优秀

- ✅ 完全离线:所有数据本地处理,不上传云端,隐私安全有保障

- ✅ 无缝对接:原生支持 OpenClaw、Ollama 等主流部署平台

四、开源协议(开发者福音)

Gemma 4 采用Apache 2.0 协议,这意味着:

- 完全免费商用

- 可自由修改、二次开发

- 可私有部署

- 无任何使用限制

这是目前对开发者最友好的开源协议之一,极大降低了企业和个人的使用门槛。

五、硬件要求与模型精准匹配

仅支持 NVIDIA 独立显卡,Intel/AMD 核显及独立显卡均不支持,这是所有本地大模型的通用限制。模型加载优先级:显存 (VRAM) > 系统内存。(红客ai)

官方显存需求

| 模型版本 | 量化格式 | 最低显存需求 | 推荐显存 |

|---|---|---|---|

| 4B | Q4_K_M | 3GB | 6GB |

| 26B(MoE) | Q4_K_M | 14GB | 16GB |

| 31B | Q4_K_M | 16GB | 20GB |

| 31B | BF16 (满血版) | – | 64GB |

实测硬件 – 模型匹配表(2026 年)

结合大量用户实测数据,我们整理了最适合国内用户的配置方案:

| 硬件配置 | 推荐模型(Q4_K_M 量化版) | 实际体验 |

|---|---|---|

| 8GB 内存 + 3-6GB NVIDIA 显存 | gemma4:4b:q4_K_M | 流畅运行,适合日常问答、简单编程 |

| 16GB 内存 + 6-8GB NVIDIA 显存 | gemma4:4b:q4_K_Mqwen3.5:9b:q4_K_M | 多模态体验良好,可处理中等复杂度任务 |

| 16GB 内存 + 12-16GB NVIDIA 显存 | gemma4:26b:q4_K_Mqwen3.5:14b:q4_K_M | 接近云端模型效果,支持复杂推理和编程 |

| 32GB 内存 + 20GB 以上 NVIDIA 显存 | gemma4:31b:q4_K_Mqwen3.5:27b:q4_K_M | 旗舰级体验,可构建完整 Agent 系统 |

重要提示:Q4_K_M 是目前最推荐的量化格式,在保持 90% 以上模型精度的同时,显存占用仅为原版的 40% 左右。不要盲目追求最大模型,否则会出现严重卡顿甚至无法加载。

六、Ollama 安装与模型部署

Ollama 是目前最简单、最稳定的本地大模型部署工具,一键即可完成安装和模型管理。

第一步:安装 Ollama

直接从官网下载对应系统的安装包手动安装:

- 官网地址:ollama.com/download

- 支持 Windows 10/11、macOS 12+、Ubuntu 20.04 + 等主流系统

第二步:启用 CUDA 加速(关键步骤)

这是确保模型使用显卡加速的核心操作:

Windows(PowerShell 临时生效)

powershell

$env:OLLAMA_CUDA=1

Linux/macOS(终端临时生效)

export OLLAMA_CUDA=1

永久生效(推荐)

- Windows:系统属性 → 高级 → 环境变量 → 新建系统变量,变量名

OLLAMA_CUDA,变量值1 - Linux/macOS:在

~/.bashrc或~/.zshrc末尾添加export OLLAMA_CUDA=1,然后执行source ~/.bashrc

第三步:拉取 Gemma 4 模型(默认q4_K_M为量化版)

根据你的硬件配置,在终端执行对应的命令:

# 入门级(3-6GB显存)

ollama pull gemma4:4b

# 主流级(8-12GB显存)

ollama pull gemma4:26b

# 旗舰级(16GB以上显存)

ollama pull gemma4:31b

第四步:测试模型运行

# 直接运行模型进行对话

ollama run gemma4:4b

如果成功进入对话界面,说明模型部署完成。

七、OpenClaw 一键对接与使用

OpenClaw(俗称 “小龙虾”)是一款功能强大的 AI 助手工具,支持多模型管理、Web 界面、API 接口等功能,与 Gemma 4 完美兼容。

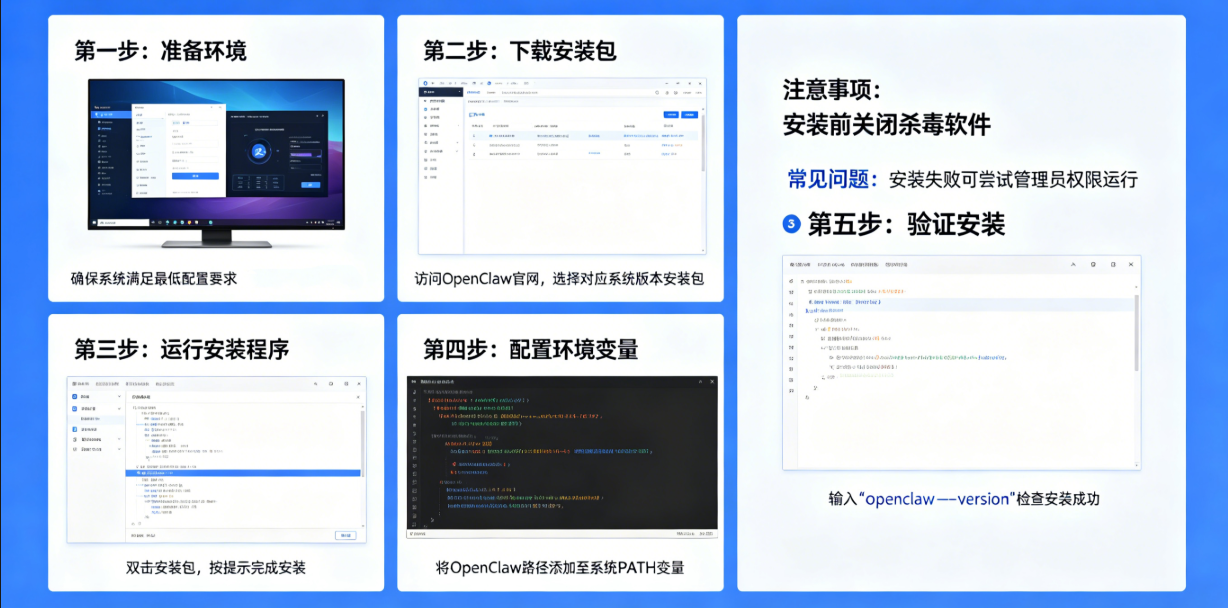

第一步:安装 OpenClaw

官方脚本(macOS/Linux)

curl -fsSL --proto '=https' --tlsv1.2 https://openclaw.ai/install.sh | bash

手动安装(Windows)

- 安装 Node.js 22+:从 nodejs.org下载 LTS 版本

- 安装 Git:从 git-scm.com下载

- 以管理员身份打开 PowerShell,执行:

npm install -g openclaw

第二步:初始化与启动

# 首次运行必须执行,完成基础配置

openclaw onboard

# 启动网关服务

openclaw gateway start

访问地址:http://localhost:18789(Web 管理面板)

第三步:一键对接 Gemma 4

OpenClaw 提供了两种对接方式,推荐使用 Web 面板:

方法一:Web 面板配置(推荐)

- 访问

http://localhost:18789 - 点击左侧菜单 “模型”→”添加模型”

- 填写以下参数:

- Provider:Ollama

- Base URL:

http://localhost:11434/v1 - API Key:

ollama(Ollama 默认无需真实密钥) - Model Name:填写你拉取的模型名称(如

gemma4:4b:q4_K_M)

- 点击 “保存” 并设为默认模型

方法二:命令行配置

openclaw config set model.provider ollama

openclaw config set model.baseUrl http://localhost:11434/v1

openclaw config set model.apiKey ollama

openclaw config set model.name gemma4:4b:q4_K_M

# 重启服务使配置生效

openclaw gateway restart第四步:服务验证

# 检查所有服务状态

openclaw status

# 测试模型连接

openclaw models test ollama

# 快速对话测试

openclaw chat "你好,请介绍一下Gemma 4"

其他命令:

PowerShell 执行策略:

Set-ExecutionPolicy RemoteSigned

手工下载模型导入 Ollama 的方法

https://modelscope.cn/models

下载好对应文件后,按以下步骤导入,导入完成后 Ollama 桌面端、OpenClaw 都能直接识别使用:

在下载好的 GGUF 文件同文件夹,新建文本文档,重命名为Modelfile(必须去掉.txt后缀);

用记事本打开Modelfile,只写一行内容(替换为你下载的模型文件名):

FROM ./Qwen3.5-9B-Q4_K_M.gguf

在当前文件夹按住Shift右键空白处,选择「在此处打开 PowerShell 窗口」,执行导入命令:

ollama create qwen3.5:9b -f ./Modelfile

导入完成后,执行ollama list即可看到模型,重启 OpenClaw 网关就能正常调用。八、Gemma 4 实测效果展示

根据大量用户实测,Gemma 4 在以下方面表现尤为突出:

1. 逻辑推理能力

比如输入问题:”为什么端口映射后外网无法访问?”

模型可以自动分析网络结构,找出可能的问题点,并给出详细的排查步骤,逻辑清晰且实用性强。

2. 多模态 + 编程能力

比如上传一张系统架构图,Gemma 4 可以自动识别图中的组件和连接关系,并生成完整的 Docker Compose 部署文件,真正实现 “看图写代码”。

3. AI 生成游戏(代码结构清晰,注释详细,很容易进行二次修改)

比如通过一张游戏截图,Gemma 4 就能生成一个可运行的 HTML5 小游戏,包含完整的游戏逻辑和界面,体验流畅。

4. Agent 自动化能力

结合 OpenClaw 的工具调用功能,Gemma 4 可以实现:

- 自动抓取新闻并生成摘要

- 自动翻译多语言文档

- 自动生成 Markdown 格式的博客文章

- 自动执行系统命令完成日常任务

九、常见故障处理

- 模型加载失败:显存不足,更换更低规格的量化版本

- 显卡未被调用:确认已正确配置

OLLAMA_CUDA=1环境变量 - OpenClaw 无法连接 Ollama:检查 Ollama 服务是否启动,11434 端口是否被占用

- 无法访问 Web 面板:检查 OpenClaw 网关服务是否启动,18789 端口是否被防火墙拦截

- 推理速度慢:关闭其他占用显存的程序,降低模型规格,更新 NVIDIA 驱动到最新版本

十、总结与使用建议

Gemma 4 的发布是开源 AI 发展的重要里程碑,它证明了本地大模型也能拥有接近云端的性能。对于大多数用户来说,4B 版本是性价比最高的选择,在 6GB 显存的显卡上就能流畅运行,满足日常使用需求。

如果你有更高的性能要求,可以根据自己的硬件配置选择 26B 或 31B 版本。配合 OpenClaw 使用,你可以打造一个完全属于自己的、离线运行的 AI 助手,保护隐私的同时享受 AI 带来的便利。

ai技术实时更新,具体以实际为准,不会安装可以联系网站客服远程安装!红客AI。